在数据爆炸的时代,大数据已成为驱动社会进步和产业变革的核心生产要素。大数据信息处理服务,作为挖掘数据价值、赋能决策的关键环节,其自身的质量直接关系到分析结果的准确性与应用的有效性。因此,构建一个适应大数据特性的新型质量体系,已不再是传统质量管理的简单延伸,而是一项涉及理念、技术、流程和文化的系统性重构工程。

一、 核心理念:从“事后检验”到“全链路治理”

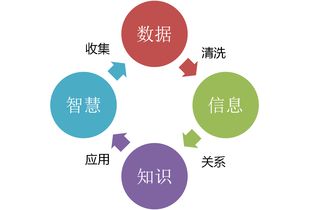

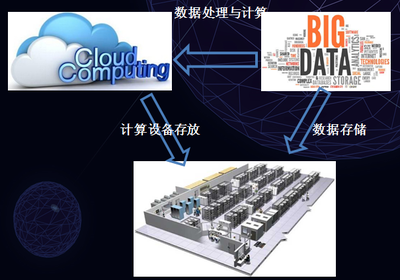

传统质量管理的重心往往放在最终产品的检验上,即“事后控制”。大数据处理的链条极长,从数据的采集、传输、存储、清洗、计算、分析到可视化与应用,任何一个环节的微小偏差都可能在后续环节被指数级放大,导致“垃圾进,垃圾出”的严重后果。因此,新型质量体系的核心必须是 “全链路数据治理”。这意味着质量控制的关口需要前移至数据产生的源头,并贯穿数据处理的全生命周期。其目标不仅是确保最终报告或模型的“正确”,更是要保障原始数据的 “可信”、处理过程的 “可控” 以及最终结果的 “可解释”。

二、 关键技术支柱:构建智能化的质量保障基座

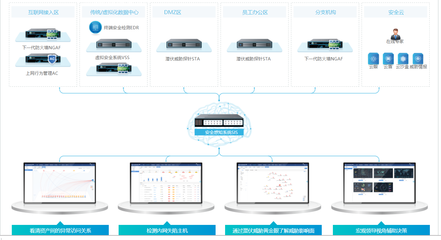

1. 数据可观测性技术:这是质量体系的“感知神经”。通过部署全面的数据监控、链路追踪和血缘分析工具,实现对数据从源头到消费端的实时状态、流动路径和依赖关系的透明化洞察。一旦数据出现异常(如值域突变、流量锐减、血缘断链),系统能够快速预警并定位根因。

2. 自动化质量校验规则引擎:针对大数据多源、异构、高速的特点,必须依赖自动化规则进行批量、实时校验。这包括完整性(数据是否齐全)、准确性(数据是否正确反映现实)、一致性(不同来源数据是否矛盾)、时效性(数据是否及时更新)以及唯一性等多维度规则。规则引擎需支持灵活定义和动态调整。

3. 基于AI/ML的智能质量检测:对于复杂、非结构化的数据(如文本、图像、日志),传统规则难以覆盖。利用机器学习模型进行异常模式识别、数据漂移检测和质量预测,可以实现更高级、更智能的质量控制。例如,通过模型监控预测数据分布的变化对下游分析模型性能的影响。

三、 流程与文化:融入敏捷与协作的组织DNA

1. DevOps与DataOps的融合:借鉴软件开发的DevOps思想,大数据质量体系应融入 DataOps 实践。这意味着数据工程师、分析师、科学家与业务用户需要紧密协作,将质量检查(如单元测试、集成测试)作为数据处理流水线(Pipeline)中不可或缺的自动化环节,实现质量的持续集成与持续交付。

2. 建立数据责任制与质量文化:明确数据的“生产者”、“所有者”、“管理者”和“消费者”在质量保障中的具体责任(即数据治理中的RACI矩阵)。将数据质量指标(如数据健康度评分)纳入团队和个人的绩效考核,从而在组织内部培育“人人关注数据质量”的文化氛围。

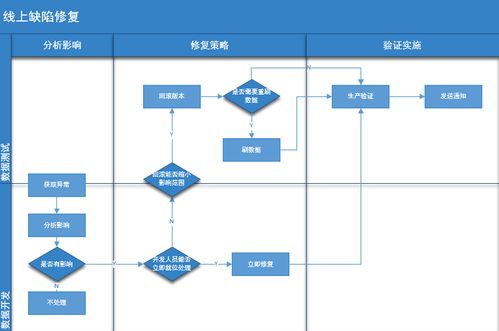

3. 闭环管理机制:建立从质量问题的发现、记录、分派、修复到验证的完整闭环流程。利用故障库积累经验,防止同类问题反复发生,实现质量的持续改进。

四、 实践价值:驱动信息处理服务提质增效

一个健全的大数据质量体系,能为信息处理服务带来显著价值:

- 提升决策可靠性:高质量的数据是精准分析、科学决策的基石,能有效降低因数据错误导致的决策风险。

- 降低运营成本:在早期环节发现并修复数据问题,其成本远低于在业务应用后补救的成本,同时减少了大量无效的数据清洗和返工。

- 加速数据价值释放:稳定、可信的数据管道和自动化的质量保障,使得数据分析师和科学家能够更专注于高价值的探索与创新,而非深陷数据泥潭,从而加快从数据到洞察的转化速度。

- 增强服务信任度:对外提供数据服务或产品时,高水平的数据质量是建立客户信任、塑造专业品牌的核心竞争力。

****

大数据下的质量体系建设,是一场从“管控”到“赋能”的深刻变革。它不再是一套孤立的规章制度或技术工具,而是深度融合于大数据信息处理服务血液中的能力框架。通过构建以全链路治理为理念、以智能技术为支柱、以敏捷文化为支撑的新型质量体系,我们才能确保在数据的海洋中精准导航,真正释放大数据的磅礴力量,驱动信息服务迈向更智能、更可靠、更高效的新阶段。